Xiaomi hat ein KI‑Modell mit 4,7 Milliarden Parametern entwickelt, das visuelle Wahrnehmung, Sprache und Steuerung für Roboter kombiniert.

Xiaomi tritt in den Robotikmarkt ein

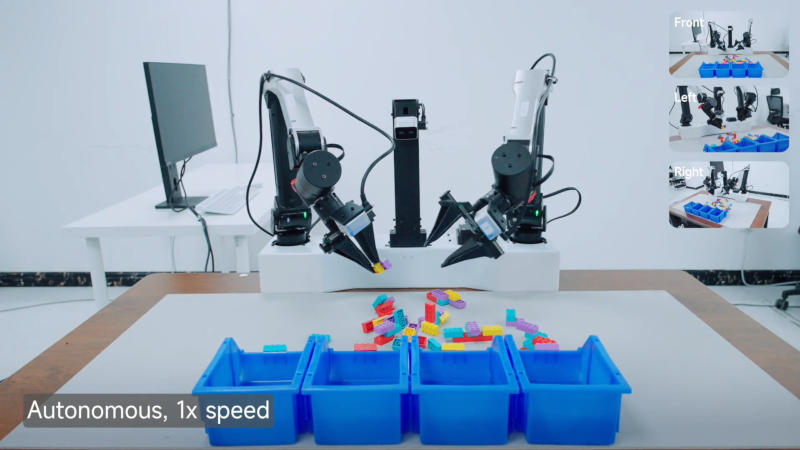

Der chinesische Riese der Mobilgeräte und Smart-Home-Lösungen, bekannt als Xiaomi, hat einen neuen Schritt angekündigt: die Entwicklung eines eigenen KI-Modells für Roboter. Das Unternehmen stellte Xiaomi‑Robotics‑0 vor, ein Open‑Source-System, das visuelle Erkennung, Sprachverständnis und Echtzeit-Aktionssteuerung kombiniert. Das Modell umfasst 4,7 Mrd. Parameter und hat bereits mehrere Rekorde sowohl in Simulationen als auch in der Praxis aufgestellt.

Wie das Modell funktioniert

Ein Roboter durchläuft typischerweise den Zyklus „Wahrnehmung → Entscheidung → Aktion“. Xiaomi‑Robotics‑0 balanciert zwischen umfassendem Situationsverständnis und präziser Motoriksteuerung dank der Mixture‑of‑Transformers (MoT)-Architektur.

1. Visuell‑sprachliches Modell (VLM) – das „Gehirn“ des Systems.

* Trainiert, Befehle zu interpretieren, auch unscharfe („Bitte falte das Handtuch“).

* Versteht räumliche Beziehungen anhand hochwertiger Bilder.

* Aufgaben: Objekterkennung, Beantwortung visueller Fragen und logisches Denken.

2. Aktions-Experte (Action Expert) – Bewegungsgenerator.

* Basierend auf einem Diffusions‑Transformer (DiT).

* Generiert nicht nur eine Aktion pro Schritt; bildet stattdessen eine Sequenz von Aktionen durch Matching der Ströme, was Flüssigkeit und Genauigkeit gewährleistet.

Training ohne Verlust des Verständnisses

Typische VLMs verlieren einen Teil ihrer Wahrnehmungsfähigkeiten beim Training an physischen Aufgaben. Xiaomi löste dieses Problem, indem es das Modell gleichzeitig mit multimodalen Daten (Bilder + Text) und Aktionsdaten trainiert hat. Der Trainingsprozess besteht aus mehreren Phasen:

1. Aktionsvorschlag – Das VLM prognostiziert mögliche Aktionsverteilungen zu Bildern und synchronisiert die interne Repräsentation mit realen Operationen.

2. Danach wird das VLM „ausgeschaltet“, und DiT durchläuft ein separates Training zur Generierung präziser Sequenzen aus Rauschen, basierend auf Schlüsselmerkmalen statt Sprachtokens.

Minimierung von Verzögerungen

Um Pausen zwischen Modellvorhersagen und den realen Bewegungen des Roboters zu beseitigen, wird eine asynchrone Ausgabe verwendet: KI-Berechnungen und Roboteraktionen sind getrennt. Dadurch können Roboter kontinuierlich bewegen, auch wenn zusätzliche Berechnungen erforderlich sind.

* Clean Action Prefix – Methode zur Rückkehr vorheriger Vorhersagen, die Flüssigkeit ohne Ruckler gewährleistet.

* Aufmerksamkeitsmaske konzentriert sich auf die aktuelle visuelle Sequenz und ignoriert vergangene Zustände, wodurch der Roboter besser auf plötzliche Umgebungsänderungen reagiert.

Ergebnisse

In den Simulationsumgebungen LIBERO, CALVIN und SimplerEnv übertraf Xiaomi‑Robotics‑0 etwa 30 Konkurrenten. Auf einem realen Robot mit zwei Manipulatoren bewältigte das Modell erfolgreich komplexe Aufgaben: Handtuchfalten, Demontage eines Baukastens. Der Roboter zeigte eine stabile Koordination von Händen und Augen und manipulierte Objekte in verschiedenen Szenarien gleichermaßen effektiv.

Damit hat Xiaomi nicht nur sein Produktportfolio erweitert, sondern auch die Grundlage für weitere Forschungen im Bereich des „physikalischen Intelligenz“ von Robotern gelegt.

Asted Cloud

Asted Cloud

Kommentare (0)

Teile deine Meinung — bitte bleib höflich und beim Thema.

Zum Kommentieren anmelden