Nvidia hat den Chip Groq 3 LPU veröffentlicht, der die Inferenz von KI-Modellen bis zur Token-Ebene beschleunigt.

Nvidia enthüllt neue Möglichkeiten der Vera Rubin-Plattform

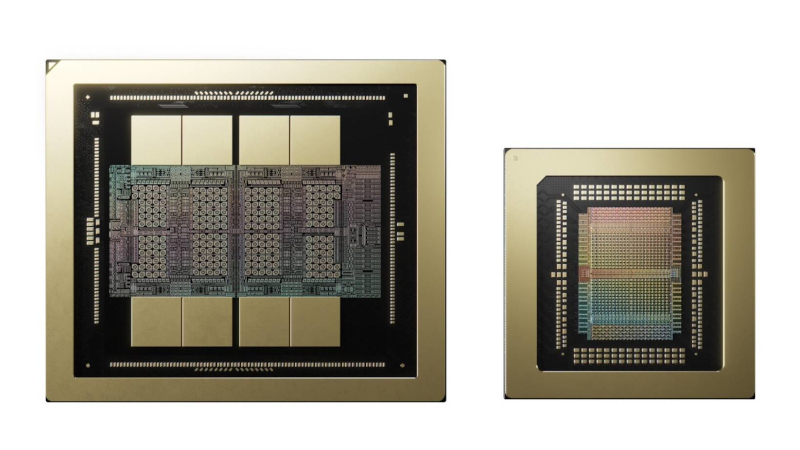

Auf der diesjährigen GTC-Konferenz kündigte der CEO von Nvidia, Jensen Huang, die Erweiterung der Vera Rubin-Plattform an. Die neuen Funktionen basieren auf geistigem Eigentum, das von Groq erworben wurde, und ein *Groq 3 LPU*-Chip ist in Rubin integriert – ein Inferenzbeschleuniger, der für die Ausgabe von Token mit hoher Geschwindigkeit und niedriger Latenz konzipiert ist.

Was bereits in Vera Rubin vorhanden ist

Die Plattform besteht aus sechs Schlüsselkomponenten, die Nvidia zu Rack-Systemen zusammenstellt und auf große AI-Fabriken skaliert:

| Komponente | Beschreibung |

|---|---|

| GPU Rubin | Grafikkarte mit 288 GB HBM4 |

| CPU Vera | Zentralprozessor |

| NVLink 6 | System für Intra-System-Skalierung |

| ConnectX‑9 | Intelligenter Netzwerkadapter |

| BlueField‑4 | Datenverarbeitungsprozessor |

| Spectrum‑X | Switch für Inter-System-Skalierung mit integrierter Optik |

Der Groq 3 LPU wurde als neues Bauelement hinzugefügt, das bei der Bereitstellung großer Systeme verwendet wird.

Warum sich der Groq 3 LPU hervorhebt

Das Hauptmerkmal ist die Speicherarchitektur. Während die meisten Beschleuniger HBM als Arbeitsspeicher nutzen, enthält jeder Groq 3 LPU 500 MB SRAM. Vergleich:

| Parameter | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Kapazität | 288 GB | 0,5 GB |

| Bandbreite | ~22 TB/s | bis zu 150 TB/s |

Für Inferenzaufgaben, die auf Bandbreite angewiesen sind, ist SRAM offensichtlich vorteilhaft. Deshalb hat Nvidia Groq 3 in Rubin integriert – um die Token-Ausgabe zu beschleunigen.

Der Groq 3 LPX-Rack

Im Rack befinden sich 256 Groq 3 LPU-Chips, was ergibt:

- 128 GB SRAM

- 40 PB/s Gesammtbandbreite

- 640 TB/s Intra-System-Schnittstelle

Vice President für hyper‑skalierbare Lösungen Ian Buck bezeichnete dieses Rack als Co-Prozessor für Rubin und betonte seine Rolle bei der Leistungssteigerung des Dekodierens auf jeder Modellschicht und Token.

Auswirkung auf Multi-Agenten-Systeme

Buck bemerkte, dass der Groq 3 LPX ein Schlüsselkomponente für den zukünftigen AI‑Markt – Multi-Agenten-Systeme – sein wird. Wenn Agenten Daten direkt austauschen statt über Chatbots, ändern sich die Reaktionsanforderungen: von 100 Token/s bis zu 1 500+ Token/s und darüber hinaus.

Wettbewerber und Perspektiven

Der Text erwähnt den Konkurrenten Cerebras, der einen Wafer‑Scale Engine (WSE) mit massivem SRAM für niedrige Latenz-Inferenz nutzt. OpenAI hat bereits Cerebras in seinen fortschrittlichen Modellen eingesetzt, dank günstiger Latenz.

Buck wies auch darauf hin, dass die Einführung des Groq 3 LPU die Abhängigkeit von Rubin CPX-Beschleunigern verringern könnte. Während Nvidia sich auf die Integration des Groq 3 LPX-Racks in die Plattform konzentriert, sollen beide Chips den Inferenzprozess stärken, ohne große GDDR7‑Speichermengen zu benötigen.

Fazit:

Der neue Groq 3 LPU-Chip und sein LPX-Rack verstärken Vera Rubin im Bereich niedriger Latenz-Inferenz, ebnen den Weg für schnellere Multi-Agenten-AI-Systeme und konkurrieren mit Akteuren wie Cerebras.

Asted Cloud

Asted Cloud

Kommentare (0)

Teile deine Meinung — bitte bleib höflich und beim Thema.

Zum Kommentieren anmelden