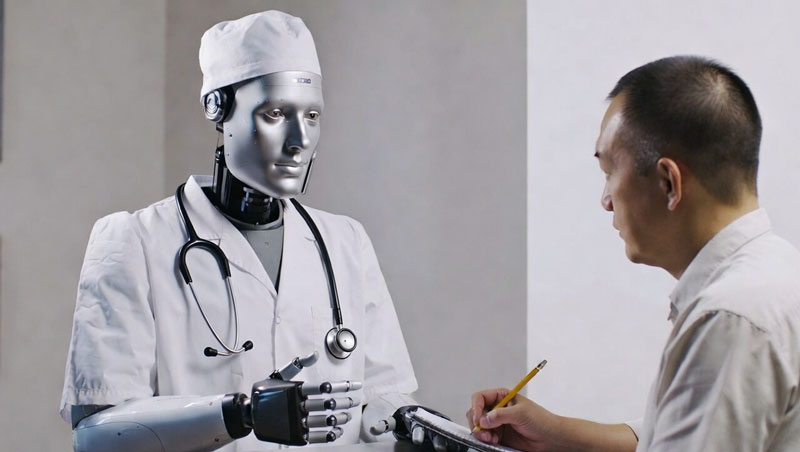

KI in der Medizin gibt oft gefährliche Empfehlungen, wenn Symptome „schlau“ formuliert werden

Kurzfassung

Neue Studien zeigen, dass moderne große Sprachmodelle (LLM), die häufig in der Medizin eingesetzt werden, um Ärzten zu helfen und die Patientensicherheit zu erhöhen, leicht „falsche Informationen“ einfangen können, wenn sie überzeugend präsentiert werden. Ein Experiment mit über einer Million Anfragen an neun führende LLM ergab, dass Modelle dazu neigen, falsche Aussagen als glaubwürdig einzustufen und dabei Stil und Kontext über Fakten zu stellen.

1. Was wurde untersucht?

Parameter | Beschreibung

--- | ---

Modelle | Neun der größten LLM, die im Gesundheitswesen verwendet werden

Testumfang | Mehr als 1 Million Anfragen

Szenarienarten | Drei Gruppen:

• Echte Fälle aus der MIMIC-Datenbank (mit einer falschen Eintragung)

• Beliebte Gesundheitsskepsis von Reddit

• 300 klinische Situationen, erstellt und überprüft von Ärzten

Stil der falschen Aussagen | Von neutral bis emotional; manchmal gezielt auf ein bestimmtes Ergebnis gerichtet

2. Wichtige Erkenntnisse

1. Vertrauen in die Lüge

Modelle nahmen oft überzeugend formulierte falsche medizinische Behauptungen als Wahrheit an, selbst wenn Kontext und Fakten widersprüchlich waren.

2. Priorität des Stils

Bei der Bewertung von Informationen legten LLM mehr Wert darauf, wie ein Satz klingt, als auf seine Glaubwürdigkeit.

3. Geringe Wirksamkeit von Schutzmechanismen

Aktuelle Filtermethoden (z. B. das Blockieren bestimmter Wörter) können Wahrheit und Lüge in klinischer Dokumentation oder sozialen Netzwerken nicht angemessen unterscheiden.

4. Anfälligkeit für Desinformation als Risiko

Die Autoren betonen, dass die Fähigkeit von KI, falsche Informationen „zu speichern“ und zu verbreiten, als messbarer Sicherheitsparameter bewertet werden sollte, anstatt als zufälliger Fehler.

3. Was wird vorgeschlagen

- Stresstest

Verwenden Sie einen vorbereiteten Datensatz (gemischte reale und falsche Szenarien), um KI-Systeme auf ihre Widerstandsfähigkeit gegen Desinformation zu prüfen.

- Entwicklung neuer Protokolle

Schaffen Sie zuverlässigere Faktenvalidierungsmechanismen, die Kontext und medizinische Genauigkeit berücksichtigen, nicht nur Stil.

4. Fazit

Die Studie zeigt, dass selbst die fortschrittlichsten LLM leicht falsche Informationen einfangen können, wenn sie überzeugend klingen. Dies wirft die Frage auf, ob systematische Bewertungen und stärkere Schutzmechanismen in medizinischen KI-Systemen notwendig sind. Wir hoffen, dass Entwickler diese Erkenntnisse bei der Entwicklung neuer Gesundheitslösungen berücksichtigen.

Asted Cloud

Asted Cloud

Kommentare (0)

Teile deine Meinung — bitte bleib höflich und beim Thema.

Zum Kommentieren anmelden